英伟达推出了自家版本的ChatGPT,名字很有GPU的味道——

ChatWithRTX。

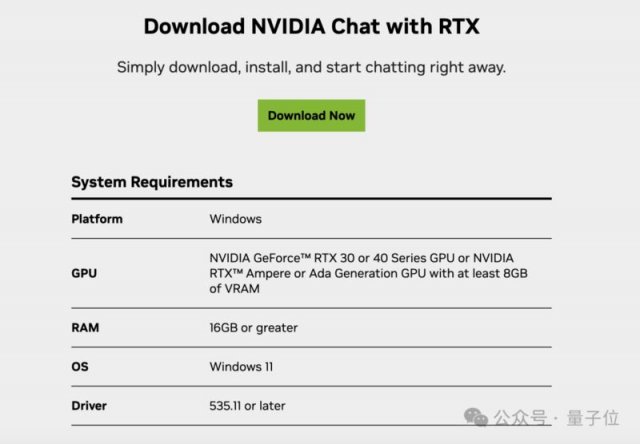

在配置方面也是要求的,只需要至少8GB的RTX30或40系列显卡即可。

那么ChatWithRTX的实际效果如何,我们继续往下看。

英伟达版ChatGPT

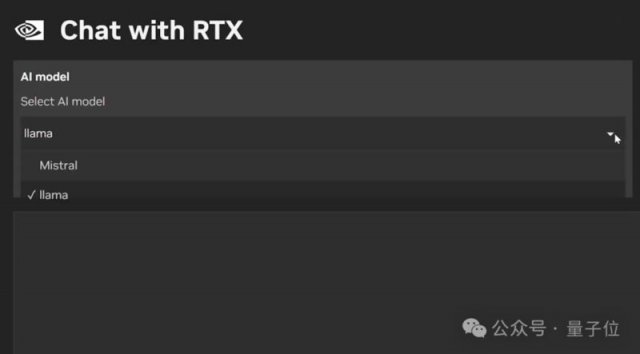

值得一提的是,ChatWithRTX并非是英伟达自己搞了个大语言模型(LLM)。

它背后所依靠的仍是两款开源LLM,即Mistral和Llama2,用户在运行的时候可以根据喜好自行选择。

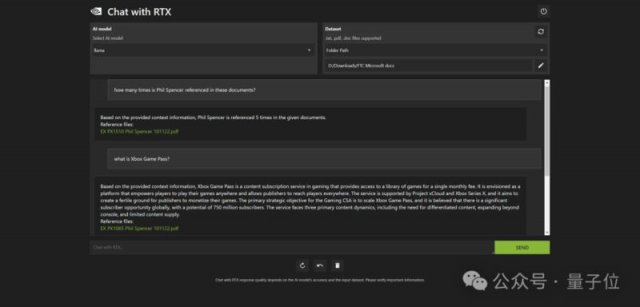

Pick完LLM之后,就可以在ChatWithRTX中上传本地文件。

支持的文件类型包括txt,.pdf,.doc/.docx和.xml。

然后就可以开始提问了,例如:Sarah推荐的餐厅名字是什么?

由于是在本地运行,因此ChatWithRTX生成答案的速度是极快的,真真儿的是“啪的一下”:Sarah推荐的餐厅名字叫做TheRedLeBernardin。

除此之外,ChatWithRTX另一个亮点功能,就是可以根据在线做回答。

例如把一个油管的链接“投喂”给它:

然后向ChatWithRTX提问:英伟达在CES2024上宣布了什么?

ChatWithRTX也会以极快的速度根据内容作答。

至于其背后用到的技术方面,英伟达官方只是简单提了一句:“用到了检索增强生成(RAG)、NVIDIATensorRTLLM软件和NVIDIARTX等。”

如何食用?

正如我们刚才提到的,ChatWithRTX的用法很简单,只需一个下载安装的动作。

不过在配置上,除了GPU的要求之外,还有一些条件,例如:系统:Windows10或Windows11

RAM:至少16GB

驱动:535.11版本或更新

不过ChatWithRTX在大小上并没有很轻量,共计大约35G。

因此在下载它之前,务必需要检查一下ChatWithRTX所需要的安装条件。

不然就会出现各种各样的悲剧了:

不过实测被吐槽

TheVerge在英伟达发布ChatWithRTX之后,立即展开了一波实测。

不过结论却是大跌眼镜。

例如刚才提到的搜索功能,在实际测试过程中,它竟然下载了完全不同的文字记录。

如果给ChatWithRTX“投喂”过多的文件,例如让ChatwithRTX为25000个文档编制索引,它就直接“罢工”崩溃了。

以及它也“记不住”上下文,因此后续问题不能基于上一个问题。

最后还有个槽点,就是下载ChatwithRTX消耗了测试人员整整半个小时……

不过槽点之外,TheVerge也比较中立地肯定了ChatwithRTX的优点。

例如搜索电脑上的文档,其速度和精准度是真香。

并且做总结也是ChatwithRTX较为擅长的

更重要的是,在本地运行这样的机制,给用户文件的安全性带来了保障。

那么你会pick英伟达版的ChatGPT吗?

参考链接:

[1]https://www.theverge.com/2024/2/13/24071645/nvidia-ai-chatbot-chat-with-rtx-tech-demo-hands-on

[2]https://news.ycombinator.com/item?id=39357900

[3]https://blogs.nvidia.com/blog/chat-with-rtx-available-now/

[4]https://twitter.com/rowancheung/status/1757429733837418610

相关科技优惠信息推荐

相关科技优惠信息推荐

科技优惠信息精选

科技优惠信息精选

领券热度排行

领券热度排行 广而告之

广而告之